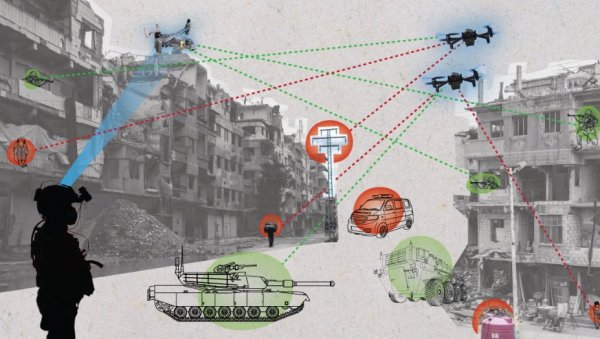

О ЖИВОТУ И СМРТИ ОДЛУЧУЈУ АЛГОРИТМИ: Злоупотреба вештачке интелигенције нарушава етичка ограничења и одговорност у ратовима

НЕОГРАНИЧЕНА примена вештачке интелигенције (ВИ) од стране војске, њено коришћење као алата за кршење суверенитета других нација, омогућавање ВИ да прекомерно утиче на ратне одлуке и давање алгоритмима моћи да одлучују о животу и смрти - четири су формуле којима је америчке војне операције у Ирану и Венецуели сажео прошле недеље портпарол кинеског министарства одбране Ђијанг Бин.

Фото: Printscreen

Стручњаци за информатику упозоравају да официри који одобравају циљеве које им даје ВИ имају највише 20 секунди да провере њихову веродостојност, што их претвара у роботе за некритичко потврђивање. То је директно потврдила америчка високотехнолошка компанија "Антропик" (Anthropic) која је пре рата у Ирану имала уговоре са Пентагоном вредне 20 милијарди долара. У њима су била строга ограничења да АИ Клод (Claude) не сме да се користи за аутономно управљање роботизованим оружјем које само одлучује о испаљивању, нити за масовни надзор грађана САД. Информатичари су бранили традиционални принцип да прислушкивање мора да буде одобрено за конкретну особу.

Они упозоравају да злоупотребљени ВИ системи врше тотални надзор усисавајући све податке о свим грађанима на све начине, помоћу снимака јавних камера које препознају не само лица већ и начин хода и држање, до мобилних телефона који непрестано одају локацију власника и чији се позиви и поруке анализирају. За такву ВИ сваки грађанин је унапред "сумњиво лице" под присмотром. Информатичари су указали да је то стручни проблем "црне кутије" јер ни они заправо не знају тачно зашто ВИ некога оцењује високо сумњивим или опасним.

СУМЊИВА ЛИЦА

УПОТРЕБА АИ система попут израелских "Лавандера" и "Јеванђеља" из темеља мења концепт правне државе и људских права, јер се процеси који су некада захтевали судске налоге и људску процену сада селе у сферу аутоматизације и увођење "кривице по асоцијацији", односно "алгоритамске сумње". Ови системи функционишу на бази "повезаности" па ако уоче да мета, на пример криминалац или припадник милитантне групе, често одлази у исти фризерски салон или продавницу, или наручује храну из истог ресторана, АИ аутоматски маркира берберина, продавца и угоститеља и њихове локале као сумњиве и потенцијалне војне циљеве. Управо тако информатичари објашњавају актуелна људском логиком несхватљива разарања десетина хиљада цивилних објеката у Ирану и Либану.

Поједностављено, програмер каже машини: "Ево ти подаци о 1.000 потврђених терориста и 1.000 цивила, а сам пронађи милионе ситних сличности међу њима које ми људи не видимо". Тако, на пример, функционише израелски "лавендер" за праћење исламских милитаната који анализира хиљаде параметара истовремено: ко кога зове, колико трају позиви, којом рутом се особе крећу, у које време мењају локацију. Оцена ВИ да је неко опасан или део терористичке мреже је резултат милијарди математичких операција и ни сам програмер не може тачно да објасни која је тачно комбинација од хиљаду фактора била пресудна за конкретног човека.

При томе се ВИ алат "самоусавршава" и временом софтвер може почети да кажњава људе, на шта је недвосмислено упозорио Ђијанг Бин: "Давање алгоритмима моћи да одлучују о животу и смрти не само да нарушава етичка ограничења и одговорност у ратовима, већ и ризикује да се технологија одметне. Тај тренд носи ризик да се филм 'Терминатор' који приказује самосвесни програм вештачке интелигенције који изазива нуклеарну апокалипсу претвори у стварни живот".

Фото: Printscreen

Да Трампова администрација није узела за озбиљно опасност да војни команданти верују "непогрешивој математици" ВИ иако ни сами не разумеју како функционише, показао је захтев Пентагона компанији "Антропик" да уклони етичке рестрикције из Клода, а када је она одбила председник Трамп ју је оптужио за "недостатак патриотизма" и "воук" идеологију. Она је проглашена као "ризик за ланац снабдевања" што је етикета која се обично користи за непријатељске стране фирме, а свим федералним агенцијама и војним сарадницима је забрањено да користе њене производе.

Конкурентски OpenAI видео је шансу и потписао уговор са Пентагоном, а "Антропик" је тужио владу САД суду уз образложење да је њена одлука неуставна и представља одмазду због њихових етичких ставова. Појавио се и нови проблем, када су медији попут "Вол стрит џорнала" и "Аксиоса" известили да се "Антропиков" четбот Клод ипак користи као део система за идентификацију мета током масовних ваздушних удара на Иран, уграђен у систем Мавен (Maven Smart System), главни програм Пентагона за анализу снимака из ваздуха и сензорских података ради откривања мета. Убрзавање планирања операција помоћу ВИ је омогућило Пентагону да изврши ударе на преко 1.000 мета у року од само 24 сата, а то се показало као главни узрок катастрофалних грешака у идентификацији.

Најтрагичнији пример био је ракетни напад на основну школу за девојчице у иранском Минабу, где је страдало најмање 165 особа, већином деце узраста седам до 12 година. Вес Џ. Брајант, некадашњи виши саветник у Пентагону, у анализи за "Њујорк тајмс" је потврдио да школа није колатерална штета, већ да је уништена "савршеним погоцима" јер је погрешно идентификована као део војног објекта иако се на сателитским снимцима од 2018. јасно види да је реч о школи.

Фото: Printscreen

ВИ очигледно није ажурирала снимке а човек који је одобрио циљ је подредио своје расуђивање софтверу који је лансирао пројектиле са намером да произведе што више жртава. Наиме, нису све ученице страдале у првом удару. Један од наставника и директор су преместили преживеле у удаљену школску молитвену салу, али управо када су стигли родитељи и спасиоци уследио је други напад на то склониште. ВИ није разликовала децу, родитеље и спасиоце од војника, топлотни сензори су регистровали само људска бића у покрету које је требало уништити.

Био је то први од до сада више пута документованих акција које се у америчкој војној и безбедносној терминологији називају double tap, вишеструком удару са задршком у коме први пројектил погађа мету, а следећи долази након пет, 10 или 15 минута, за време које ВИ процени да је потребно да се људи окупе око рушевина. По међународном ратном праву то је ратни злочин, али софтвер не може да се изведе на суд. То је савршено покриће за технологију злочина које је НАТО под руководством САД чинио против цивила током агресије на Србију, само много брже и разорније.

На школу у Минабу је примењена иста тактика као при ракетирању зграде Генералштаба у Београду у ноћи између 29. и 30. априла 1999. Напад је изведен у два таласа са размаком од око 15 минута, што је довело до страдања ватрогасаца, спасилаца и фоторепортера "Новости" Игора Маринковића који су дошли на лице места. Тада није постојала ВИ у данашњем смислу, али је коришћена претеча дигиталног ратовања која је поставила темеље за данашње системе.

Ракете "томахавк" су користиле систем TERCOM (Terrain Contour Matching), пројектил је у меморији имао дигиталну 3Д мапу терена коју је током лета упоређивао са оним што "види" својим радаром, па је сам кориговао курс како би погодио циљ. Тадашњи напади нису зависили од АИ која у реалном времену види покрет спасилаца, већ од хладног војног прорачуна који се зове time-on-target: планери у команди НАТО су унапред програмирали ракете да ударе у размаку од 15 минута и то је била стратегија да се десеткује противник који притекне у помоћ, што је био ратни злочин за који нико није одговарао.

Фото: X printskrin/wion

То што су тада радили конкретни људи - ратни злочинци, данас обавља АИ препознајући "неуспех уништења мете" ако има знакова живота, после чега самостално сугерише или активира следећи удар. Оно што је 1999. било механичко извршење зле намере, данас је алгоритамско; технологија је омогућила да се размак између два удара скрати и да се из њега потпуно избаци људско оклевање. То је савршен механизам за извођење некажњених злочина јер ако АИ погреши, не постоји правни оквир који даје одговор на питање ко је крив: програмер који је писао код, официр који је притиснуо дугме или држава која је дозволила употребу софтвера?

Стављање ВИ под контролу постало је врхунска тема широм планете јер је постало јасно да она неће контролисати само оружане сукобе, већ да прети да постане алат тоталитаризма у миру, који чак неће контролисати ни државе већ "дигитални феудалци", власници информатичких компанија. Као злоћудан пример наводи се израелски систем који је већ у пракси показао да је у стању да анализира податке о готово целокупном становништву (друштвене мреже, контакте, локацију телефона) и да сваком појединцу додељује оцену од један до 100 на основу вероватноће да је повезан са милитантима, а на основу тих "оцена" формирају се листе за одстрел. По истом принципу могуће је програмирати да циљ буду припадници неке политичке струје или етничка или религиозна група, која чак и не мора да буде физички елиминисана, већ се у дигитално умреженом свету може ставити у гето.

ГДЕ ЈЕ ТАТА

СИСТЕМ вештачке интелигенције "Где је тата?" (Where is Daddy?) који користи израелска војска за лоцирање и праћење појединаца изазвао је огромне реакције због неетичности. Дизајниран је да преко података о локацији мобилних телефона просторно и временски прати особе које су претходно идентификоване као војни циљеви. Примарна улога система је да обавести операторе у тренутку када циљана особа уђе у одређени објекат, најчешће своју породичну кућу. Он тада шаље аутоматско обавештење, тзв. пинг оператерима, а то често резултира великим бројем цивилних жртава, пре свега чланова породица. Критичари указују да систем доприноси високом броју цивилних жртава јер су напади усмерени на стамбене објекте.

Препоручујемо

РХМЗ ИЗДАО ХИТНО УПОЗОРЕЊЕ: Преокрет у неколико сати, погледајте шта нас чека данас

07. 06. 2026. у 07:31

ПЉУСКОВИ И ГРМЉАВИНА ЈОШ СУ СА НАМА: Температура иде до 29 степени после јутарње кише

07. 06. 2026. у 00:00

Klikni na zvezdicu u gornjem desnom uglu i zaprati Novosti na Google News platformi

МАЂАР ИЗАШАО НА БАЛКОН ДА ПОЗДРАВИ НАРОД: Доживео велики шок и непријатност (ВИДЕО)

АКТУЕЛНИ премијер Мађарске Петер Мађар, доживео је велику непријатност приликом обраћања грађанству.

07. 06. 2026. у 12:19

"АКО КОРИСТИШ МЕГАФОН, ОНДА ТО НЕМОЈ НАЗИВАТИ ПИСМОМ" Песков оштро о Зеленском: Да је заиста желео да га преда Путину, могао је то да учини

ДА је Владимир Зеленски заиста желео да преда писмо руском председнику Владимиру Путину, могао је то једноставно да учини, без јавног објављивања, изјавио је портпарол Кремља Дмитриј Песков.

07. 06. 2026. у 13:37

НАСТАЈЕ НОВА ДРЖАВА? Српске комшије се уједињују са суседима - за моћну државу од 22 милиона душа и 272.200 км²

"УНИОНИСТИЧКИ покрет је одувек постојао и он је и даље жив унутар нашег друштва. Несумњиво је да је ова дискусија легитиман део политичког процеса у земљи. Ја лично никада не бих могао да гласам против уједињења."

02. 06. 2026. у 21:24

Коментари (0)